B) Vale:

C) El punto Q del axioma iii) es único.

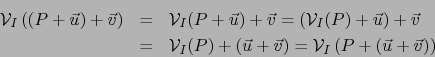

En efecto, supongamos que se tiene simultáneamente:

![]() y

y

![]() . De ahí se sigue:

. De ahí se sigue:

Espacio vectorial como modelo de un espacio afín sobre sí mismo.

Sea ![]() un espacio vectorial. Designamos por

un espacio vectorial. Designamos por ![]() otro ejemplar del propio

otro ejemplar del propio ![]() . Si

. Si

![]() , designaremos por la correspondiente letra mayúscula, en este caso por

, designaremos por la correspondiente letra mayúscula, en este caso por ![]() ,

el propio vector

,

el propio vector ![]() considerado como elemento de

considerado como elemento de ![]() .

.

![]() definimos:

definimos:

Gracias a esta observación, en todas las consideraciones donde entran a la vez espacios afines y espacios vectoriales, se puede, si conviene, mediante (1), considerarlos todos como espacios afines.

Fijemos un punto ![]() al que llamaremos ORIGEN.

al que llamaremos ORIGEN.

![]() el vector

el vector

![]() se llama el VECTOR POSICIÓN DEL PUNTO (CON RESPECTO AL ORIGEN ). Ocasionalmente

designaremos este vector también por la notación

se llama el VECTOR POSICIÓN DEL PUNTO (CON RESPECTO AL ORIGEN ). Ocasionalmente

designaremos este vector también por la notación

Demostración

Por el teorema 4.1.1 la relación

![]() implica

implica

![]() y ésta, a su vez,

por el axioma i) de espacios afines

y ésta, a su vez,

por el axioma i) de espacios afines ![]() .

.

![]()

Demostración

Observación

Las definiciones 4.1.2 introducen una convencional suma de un punto y de un vector y una, igualmente

convencional, resta de dos puntos. Si combinamos estas nuevas ``operaciones'' con la

adición y sustracción en ![]() , ¿serían válidas las identidades que tales denominaciones

implicarían?. Inesperadamente (salvo para un optimista empedernido): ¡sí!

, ¿serían válidas las identidades que tales denominaciones

implicarían?. Inesperadamente (salvo para un optimista empedernido): ¡sí!

Son ciertas, por ejemplo, las relaciones:

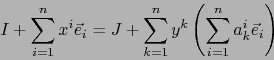

Los dos miembros de (4) son puntos. Para probar que son iguales, basta probar, en virtud del corolario del teorema 4.1.1,

que tienen el mismo vector posición con respecto a algún origen ![]() . Ahora bien, por el teorema

4.1.2 y la asociatividad de la adición en

. Ahora bien, por el teorema

4.1.2 y la asociatividad de la adición en ![]() :

:

Los dos miembros de (5) son vectores. Aplicando los teoremas 4.1.1 y 4.1.2 obtenemos:

Nota

Comprobaciones como aquéllas en la observación precedente, aunque disipan las posibles dudas del lector, no

quitan realmente el misterio del asunto. La verdadera explicación de éste estriba en que se puede construir un espacio vectorial

![]() que entre

sus elementos tiene tanto todos los puntos de

que entre

sus elementos tiene tanto todos los puntos de ![]() como todos los vectores de

como todos los vectores de ![]() . Las operaciones introducidas por las definiciones 4.1.2

coinciden con las operaciones de la misma denominación en el espacio vectorial

. Las operaciones introducidas por las definiciones 4.1.2

coinciden con las operaciones de la misma denominación en el espacio vectorial

![]() y el misterio se desvanece.

De hecho, este espacio vectorial (los coautores del libro de L. SCHWARTZ [32] lo

llaman el VECTORIALIZADO DEL ESPACIO AF´iN

y el misterio se desvanece.

De hecho, este espacio vectorial (los coautores del libro de L. SCHWARTZ [32] lo

llaman el VECTORIALIZADO DEL ESPACIO AF´iN ![]() ) permite un tratamiento sumamente elegante de

la teoría de espacios afines: una completa ``linealización'' de ésta.

) permite un tratamiento sumamente elegante de

la teoría de espacios afines: una completa ``linealización'' de ésta.

Como referencia me permito indicar al lector curioso [3]. No conozco nada sobre este tema que haya sido publicado por alguna casa editorial.

Demostración

El teorema se sigue inmediatamente de que, en virtud de los enunciados iii) y ![]() ) para todo

) para todo

![]() existe un único punto

existe un único punto

![]() tal que

tal que

![]() . Según la definición 4.1.2,

este punto no es otro que

. Según la definición 4.1.2,

este punto no es otro que

![]() .

.

![]()

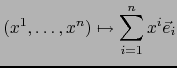

Los escalares

![]() en (7) se llaman las COORDENADAS DEL PUNTO CON RESPECTO AL REFERENCIAL

en (7) se llaman las COORDENADAS DEL PUNTO CON RESPECTO AL REFERENCIAL

![]() .

.

La biyección inversa de la biyección (7) es

Demostración

La aplicación (7) es la compuesta, en el orden que indicamos, de la biyección

de

de

![]() sobre

sobre ![]() con la biyección:

con la biyección:

![]() de

de ![]() sobre

sobre ![]() del

teorema 4.1.3. Por consiguiente, la aplicación (7) es una biyección de

del

teorema 4.1.3. Por consiguiente, la aplicación (7) es una biyección de

![]() sobre

sobre ![]() .

.

![]()

El estudio de las propiedades de ![]() mediante tal biyección es la ``geometría analítica''.

mediante tal biyección es la ``geometría analítica''.

Nota

En la terminología que usamos y que es la corriente entre los físicos, distinguimos cuidadosamente entre:

Cambio de referencial

Sean

![]() un ``antiguo'' y

un ``antiguo'' y

![]() un ``nuevo'' referencial

de

un ``nuevo'' referencial

de ![]() . Para situar el nuevo referencial con respecto al antiguo damos las ``antiguas'' coordenadas

. Para situar el nuevo referencial con respecto al antiguo damos las ``antiguas'' coordenadas

![]() de

de ![]() y las

componentes

y las

componentes ![]() de

de ![]() con respecto a la base

con respecto a la base

![]() . Tenemos pues:

. Tenemos pues:

Sean ![]() un punto arbitrario de

un punto arbitrario de ![]() ,

,

![]() las antiguas e

las antiguas e

![]() las nuevas

coordenadas de

las nuevas

coordenadas de ![]() . Vale pues:

. Vale pues:

Esta fórmula es análoga a (14) del §5 del capítulo 2. para el cambio de componentes

de un vector. Difiere de ella por la presencia del término ``constante'' ![]() en el segundo miembro.

en el segundo miembro.